深層学習とは何か?——ニューラルネットワークの仕組みをやさしく解説

はじめに

こんにちは。Altam Easeの本田直輝です。

今回は以下を解説します。

人工知能(AI)の進化の中心にある技術、それが「深層学習(Deep Learning)」です。

画像認識、音声認識、自然言語処理など、多くの分野で活躍しているこの技術は、「人間の脳の仕組み」をヒントに作られています。

この記事では、深層学習の基本となる「ニューラルネットワーク」や「線形関数」「活性化関数」といった概念を、初学者向けにわかりやすく解説します。

ニューラルネットワークとは?

ニューラルネットワークは、人間の神経細胞(ニューロン)の仕組みを模倣して作られた情報処理のモデルです。

生物の神経ネットワークと、人工ニューラルネットワークを比べると次のようになります。

| 生物の脳 | 人工ニューラルネットワーク |

|---|---|

| ニューロン(神経細胞) | ノード(ニューロン) |

| シナプス | 重み(weight) |

| 活性化(信号の発火) | 活性化関数 |

| 脳内ネットワーク | 層構造のネットワーク |

ニューロンの基本計算:線形関数+活性化関数

1つのニューロンは、次の2つの処理を行います:

🟦 ステップ1:線形変換

複数の入力 x1,x2,…,xn に重み w1,w2,…,wn を掛けて足し合わせ、バイアス b を加える:

z=w1x1+w2x2+⋯+wnxn+b

これはいわゆる線形関数です。グラフにすると直線になります。

🟩 ステップ2:非線形変換(活性化関数)

上記の線形出力 z に対して、「活性化関数」と呼ばれる非線形関数を適用します:

y=f(z)

よく使われる活性化関数:

| 名前 | 式 | 特徴 |

|---|---|---|

| ReLU | f(z)=max(0,z) | シンプルで計算が早い。今の主流。 |

| Sigmoid | f(z)=11+e−z | 出力が0〜1。確率のような出力。 |

| tanh | f(z)=tanh(z) | 出力が-1〜1。中心が0。 |

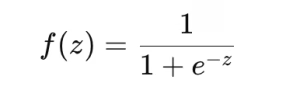

活性化関数の代表例:シグモイド関数とは?

先ほど紹介した活性化関数の中でも、シグモイド関数(Sigmoid)は、ニューラルネットワークの基礎を理解する上で非常に重要な関数です。ここでは、少し詳しく見てみましょう。

シグモイド関数は以下の式で表されます:

-

出力は常に 0〜1の範囲 に収まります

-

グラフは滑らかなS字カーブ(sigmoid = S字形)

多層パーセプトロン(MLP)とは?

単一のニューロン(パーセプトロン)だけでは線形の問題しか解けません。

これを複数層に重ねたものが 多層パーセプトロン(Multi-Layer Perceptron, MLP) です。

構成:

-

各層で「線形関数 → 活性化関数」を繰り返します

-

非線形な問題(画像分類、音声認識など)を扱えるようになります

深層ニューラルネットワーク(DNN)とは?

MLPをさらに深くしたものが「深層ニューラルネットワーク(Deep Neural Network, DNN)」です。

-

「隠れ層が2〜3層以上」あれば「深層(Deep)」と呼びます

-

実際のAI応用では、数十層〜数百層のDNNが使われることもあります

MLP ⊂ DNN

→ MLPはDNNの一種。DNNはより広い概念で、CNNやRNNなども含まれます。

これが「深層学習(Deep Learning)」!

「深層学習(ディープラーニング)」とは、

多層のニューラルネットワークを使って、データから自動で特徴を学習する技術です。

深層学習のポイント:

| 特徴 | 説明 |

|---|---|

| 多層構造 | 複雑なデータ構造や意味を学べる |

| 自動特徴抽出 | 画像処理や音声解析で人間の手作業が不要に |

| 活性化関数 | 非線形性を導入し、高度なパターンも対応可能 |

| 誤差逆伝播法 | 学習アルゴリズムの中核。出力誤差から重みを調整 |

| GPU・ビッグデータ | 深い学習には大量のデータと計算力が必要 |

主な応用領域

| モデル | 用途 |

|---|---|

| MLP | 数値データの分類、回帰 |

| CNN | 画像認識、医療画像解析、物体検出 |

| RNN / LSTM | 時系列予測、自然言語処理 |

| Transformer(GPTなど) | 翻訳、要約、対話(ChatGPTなど) |

| GAN | 画像生成、スタイル変換 |

まとめ

| 用語 | 意味 |

|---|---|

| ニューラルネットワーク | 人工ニューロンを組み合わせたネットワーク |

| 線形関数 | 入力に比例して出力が変わる基本関数 |

| 活性化関数 | 非線形性を加える関数(ReLU、Sigmoidなど) |

| MLP | 多層構造を持った基本的なニューラルネット |

| DNN | MLPを深くしたり、他の構造も含んだ広義のネットワーク |

| 深層学習 | 多層ニューラルネットを使った学習技術の総称 |

この記事へのコメントはありません。