入力の揺らぎに強いAIとは?──頑健性(Robustness)の基礎から実践まで

こんにちは。Altam Easeの本田直輝です。

現実世界でAIを使うとき、完璧なデータだけが入力されることはほとんどありません。画像がブレていたり、センサーが誤作動したり、予期せぬ入力が来たりするのは日常茶飯事です。そんな中でもAIが安定して正しい判断をするために重要な性質、それが「頑健性(robustness)」です。

この記事では、「頑健性とは何か?」という基本から、どうすれば頑健なモデルを作れるのか、どんな場面で役に立つのかを丁寧に解説します。

頑健性とは何か?

「頑健性(がんけんせい)」とは、一言で言えばノイズや異常値、予測不能な入力に対してもモデルがブレずに安定して動作する能力のことです。英語では robustness(ロバストネス)と呼ばれます。

たとえば、画像認識モデルに対して少しノイズを加えたり、画像を数度回転させたりしても、元と同じ正しいラベルを返すようであれば、そのモデルは「頑健である」と言えます。

逆に、ほんの少しの入力の違いでまったく違う結果を返してしまうようなモデルは、実用上は信頼できません。AIの判断が安定せず、使い物にならないからです。

この「入力の揺らぎにどれだけ強いか」という視点は、実世界でAIを運用する上で非常に重要な指標です。

機械学習における頑健性の重要性

現実のデータは完璧ではありません。ノイズや欠損、外れ値は避けられない存在です。以下のような状況で、頑健性が求められます。

-

カメラの映像が少しぼやけたり暗くなったりしても、物体を正しく検出したい。

-

センサーデータに一時的なノイズが混入しても、異常検知システムは誤報を出さないでほしい。

-

ユーザーの入力ミス(例:「shippng」)があっても、正しく「shipping」と認識して検索を返したい。

こうした現実的な環境下でAIを使おうとするなら、頑健性は「実用に耐えるAI」と「理論上は正しいAI」を分ける鍵となります。

「頑健性」「汎化性能」「安定性」の違い

似たような概念に、「汎化性能(generalization)」や「安定性(stability)」があります。これらはしばしば混同されがちですが、意味は微妙に異なります。

| 用語 | 説明 | 例 |

|---|---|---|

| 頑健性(Robustness) | 入力のノイズ・外れ値・誤差に対する耐性 | 写真が少しぼやけても猫と認識できる |

| 汎化性能(Generalization) | 訓練に使っていない未知のデータに対する適応力 | 未知の人の顔写真でも正しく分類できる |

| 安定性(Stability) | モデルの初期値や学習率の違いによる出力のばらつきの少なさ | 何度学習しても結果が大きく変わらない |

つまり、頑健性は「データの変動に強いかどうか」に特化した性質であり、AIを現実環境で活用するための土台となる能力なのです。

頑健性を高める代表的な方法

頑健なモデルを作るためには、設計段階から意識的な工夫が必要です。以下に代表的なアプローチをいくつか紹介します。

1. データ拡張(Data Augmentation)

画像やテキストの学習データに対して、意図的にノイズや変換を加える手法です。

たとえば画像であれば、回転・反転・明度調整・ノイズ追加などが該当します。これによって、モデルは「同じ意味なのに見た目が違うデータ」にも慣れ、入力の揺らぎに強くなります。

これは特に画像認識や音声認識などで高い効果を発揮します。

2. Dropout・正則化

ニューラルネットワークでは、過学習(overfitting)を防ぐために正則化を行うことがよくあります。

Dropoutは、学習時にランダムにニューロンを無効化することで、「一部の特徴だけに依存する」ことを防ぎます。

これにより、入力の一部が変化しても出力が安定しやすくなります。

またL1やL2正則化によって、パラメータの異常な増大を防ぐことで、学習をより安定・頑健にします。

3. 敵対的訓練(Adversarial Training)

わざとノイズや微小な変化を加えてモデルを騙すような入力(敵対的例)を用いて学習する手法です。

このアプローチでは、脆弱性のある入力を事前に学習させることで、モデルが予期せぬ攻撃やノイズにも強くなります。

セキュリティが重視される分野では、Adversarial Trainingは重要な手段です。

4. 損失関数の工夫

例えば回帰問題で外れ値が混ざっていると、二乗誤差(MSE)ではその影響が大きくなります。

代わりにHuber損失やMAE(平均絶対誤差)を使うと、外れ値の影響が抑えられ、より頑健な学習が可能になります。

頑健性の評価方法は?

頑健性の評価は、一般的な精度評価とは少し異なります。例えば以下のような方法でチェックされます。

-

ノイズ付きデータでの精度比較(例:画像にガウシアンノイズを加える)

-

入力の変換に対する出力の変化の観測(例:テキストを1単語だけ変えても意味が変わるか)

-

敵対的入力に対する分類性能の検証(Adversarial Accuracy)

重要なのは、「現実的な異常やエラーが加わった場合にもモデルが機能するか?」という視点でモデルを試すことです。

実務における頑健性の活用例

-

自動運転:カメラの映像に雨や反射があっても、正確に標識を認識できる。

-

医療画像診断:撮影条件が異なる病院の画像でも安定した診断が可能。

-

チャットボット:ユーザーのタイプミスや言い回しの違いにも正確に応答する。

-

不正検出:異常パターンの一部だけが変化しても、検出精度が下がらない。

このように、頑健性の高いモデルは、現実世界での実用化に直結しています。

まとめ:AIを本当に「使える」ものにするために

頑健性とは、単なる「技術的なオプション」ではなく、AIを社会の中で活用するために欠かせない前提条件です。

理想的なデータではなく、現実の“不完全な”データに耐えられるAIこそが本当に価値あるAIです。

頑健性を意識してモデル設計・データ作成・評価を行うことで、現場で役立つAIを作り出す第一歩となります。

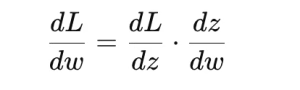

これにより、複雑な層構造を持つネットワークでも、正確に勾配を求めることができます。

全体の学習の流れ

[入力 x]

↓

[順伝播: モデル出力 ŷ を計算]

↓

[ロス関数: ŷ と正解 y のズレを計算]

↓

[逆伝播: ロスから各重みへの勾配を計算]

↓

[勾配降下法: 重みを更新し、再び順伝播へ]

↓

[繰り返し: ロスが十分小さくなるまで]

おわりに

ニューラルネットワークの学習は、表面的には「たくさんのデータを流して重みを調整する」だけに見えるかもしれません。しかし実際には、「最適化問題を勾配を使って解く」という数学的な美しさが背後にあります。

これらの基本を理解することで、深層学習の実装やチューニング、さらには独自モデルの開発にも役立つはずです。

この記事へのコメントはありません。